وبلاگ

ریسکهای سایبری در افق کوتاهمدت و بلندمدت

- نوع مطلب: مقاله

- تاریخ انتشار:

- بدون نظر

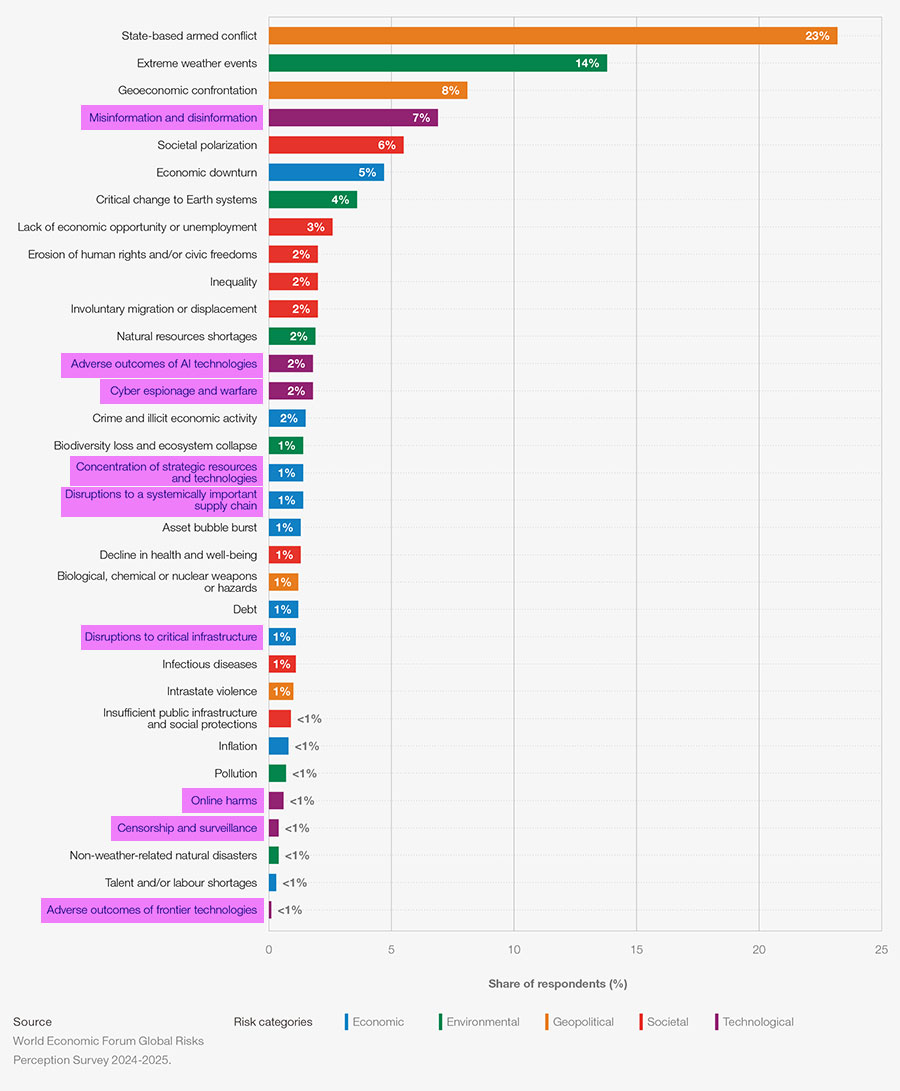

فهرست مطالب

گزارشی که پیشروی شماست، تحلیل جامعی از مهمترین ریسکهای سایبری و فناوری در سال ۲۰۲۵ است که مجمع جهانی اقتصاد (World Economic Forum) در جدیدترین گزارش خود با عنوان Global Risks Report 2025 به آنها اشاره کرده است. در این گزارش، تهدیدهای سایبری، فناوریهای مبتنی بر هوش مصنوعی مولد و نقض امنیت دادهها بهعنوان یکی بزرگترین ریسکهای جهانی در افق زمانی ۲ و ۱۰ ساله شناخته شدهاند. از شما دعوت میکنیم این گزارش را مطالعه کنید تا با پیامدهای این ریسکها برای سازمانها و متخصصان امنیت اطلاعات آشنا شوید.

جنگ سایبری و جاسوسی دیجیتال

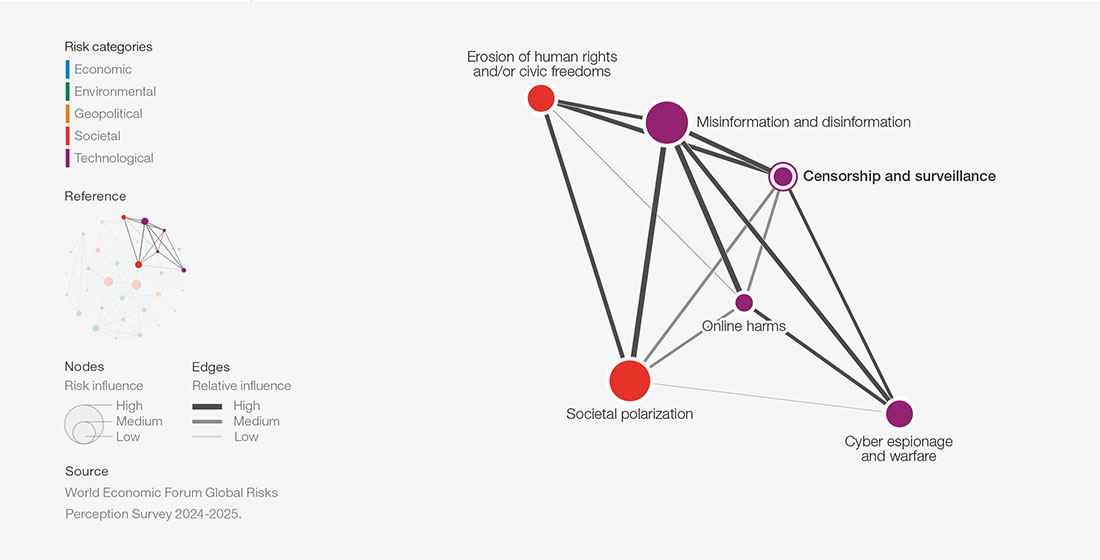

جنگ سایبری و جاسوسی دیجیتال بهعنوان یک ریسک کلیدی در رتبهبندیهای مختلف فهرست شده است. در چشمانداز ۲ساله، این ریسک در رتبه پنجم قرار گرفته است که نشاندهنده نگرانی درباره نقش این ریسک در تنشهای ژئوپلیتیک است. بازیگران دولتی و غیردولتی، با هدف کنترل بر حضور دیجیتال، ایجاد اختلال عملیاتی و بهخطرانداختن زیرساختها و شبکههای فناوری و اطلاعاتی در نهادهای مختلف از سلاحها و ابزارهای سایبری استفاده میکنند.

از پیامدهای این ریسک میتوان به افزایش تنشهای ژئوپلیتیک ازطریق حملات سایبری هدفمند، سرقت مالکیت فکری و اطلاعات حساس در زمان درگیری مسلحانه، آسیبپذیری زنجیرههای تأمین دیجیتال، تضعیف شبکههای ارتباطی و استفاده از هوش مصنوعی در حملات سایبری اشاره کرد. حتی ممکن است پیشرفتهای هوش مصنوعی باعث ادغام این فناوری با بیوتکنولوژی شود و ساخت سلاحهای بیولوژیکی را آسانتر کند. در دهه آینده، با پیچیدهتر شدن جاسوسی سایبری، هکرها ممکن است از توالیهای DNA از نمونههای جعلی برای هک رایانهها استفاده کنند. ۷۱ درصد از مدیران ارشد ریسک نسبت به تأثیر ریسک سایبری و فعالیتهای مجرمانه بر سازمانهایشان ابراز نگرانی کردهاند.

اقدامات پیشنهادی

- تقویت چارچوبهای دفاعی سایبری؛

- همکاری بینالمللی در بهاشتراکگذاری اطلاعات تهدید؛

- سرمایهگذاری در فناوریهای رمزنگاری پیشرفته.

اطلاعات نادرست و جعل محتوا با هوش مصنوعی

اطلاعات نادرست و جعل محتوا برای دومین سال متوالی، رتبه اول در چشمانداز کوتاهمدت و بلندمدت را کسب کرده است که نشاندهنده نگرانی بسیار گسترده درباره این ریسک است. استفاده فزاینده از پلتفرمهای دیجیتال و محتوای تولیدشده با هوش مصنوعی به انتشار گسترده اطلاعات نادرست از طریق شبکههای رسانهای (خواه عمدی یا غیرعمدی) دامن میزند. این مشکل باعث تغییر در افکار عمومی و بیاعتمادی به حقایق و مراجع میشود.

هوش مصنوعی مولد (GenAI) میتواند محتوای جعلی را در مقیاس وسیعی تولید و توزیع کند. ابزارهای هوش مصنوعی موانع تولید و توزیع محتوا را کاهش دادهاند، بهطوریکه نمیتوان بهراحتی میان محتوای انسانی و محتوای ساختگی با هوش مصنوعی در قالب ویدئو، تصویر، صدا یا متن تمایز قائل شد.

از پیامدهای این ریسک میتوان به اجرای خودکار و گستردهٔ کمپینهای اطلاعات نادرست از جانب آژانسهای دولتی در برخی کشورها، تشدید قطبیسازی جامعه، تضعیف اعتماد عمومی به نهادها و رسانهها و تأثیرگذاری بر انتخابات و سیاستهای عمومی اشاره کرد.

اقدامات پیشنهادی

- توسعه برنامههایی برای آموزش عمومی و افزایش آگاهی اجتماعی؛

- الزام پلتفرمها به شفافیت در محتوای تولیدشده با هوش مصنوعی؛

- ایجاد سیستمهای تشخیص خودکار محتواهای جعلی.

نظارت، سانسور و نقض حریم خصوصی

سانسور و نظارت شامل مشاهده یا سرکوب فراگیر ارتباطات، اطلاعات و ایدهها در مقیاسی است که حقوق انسانی و مدنی مانند حریم خصوصی و آزادی بیان را نقض کند؛ خواه بهصورت فیزیکی باشد یا دیجیتالی.

این ریسک با پنج پله صعود در رتبهبندی ۲ساله به رتبه شانزدهم رسیده است که نشاندهنده نگرانی روبهرشد جوامع درباره آن است. دیجیتالسازی گسترده امکان نظارت بر فعالیتهای شهروندان را برای دولتها، شرکتهای فناوری و بازیگران مخرب آسانتر کرده است.

از پیامدهای این تهدید میتوان به سرکوب آزادی بیان، افزایش نظارت دولتی بر شهروندان و محدودیتهای بیشتر بر آزادیهای فردی، سوءاستفاده از دادههای شخصی و تضعیف دموکراسی در جوامع قطبیشده اشاره کرد. برای نمونه، فیلترینگ شدید اینترنت و اجبار شهروندان به استفاده از ابزارهای تغییر آیپی را در نظر بگیرید.

اقدامات پیشنهادی

- تصویب قوانین جامع برای حفاظت از دادهها؛

- ایجاد نهادهای مستقل نظارت بر فناوریهای مورد استفاده دولت؛

- افزایش آگاهی عمومی درباره مدیریت حریم خصوصی دیجیتال.

سواد دیجیتال و مقابله با سوگیری الگوریتمی

سوگیری الگوریتمی زمانی رخ میدهد که الگوریتمهای بهکاررفته برای خودکارسازی فرایندهای حساسی مثل استخدام، پیشبینی جرم، اعطای وام و نظایر آنها، نتایج ناعادلانه تولید کنند. دلیل ایجاد چنین نتایجی، سوگیریهایی است که ذاتاً در دادهها، مدلها و توسعهدهندگان این الگوریتمها وجود دارد.

از پیامدهای این ریسک، میتوان به تبعیض سیستماتیک در تصمیمگیریهای خودکار، تشدید نابرابری اجتماعی و راندهشدن گروههای آسیبپذیر به حاشیه اشاره کرد. علاوه بر آن، کاهش اعتماد عمومی به سیستمهای هوشمند، پذیرش فناوریهای مفید را تضعیف میکند. سوگیریهای سیاسی هم بسیار خطرناکاند؛ چرا که ممکن است بر استخدام در مشاغل دولتی یا دسترسی به خدمات عمومی و مالی تأثیر نامطلوب بگذارد.

اقدامات پیشنهادی

- آموزش استفاده اخلاقی از هوش مصنوعی به توسعهدهندگان؛

- ایجاد کمپینهای جامع آگاهیرسانی برای آموزش شهروندان درباره خطرات دیجیتال مثل تنظیمات حریم خصوصی و تشخیص فیشینگ و درک نقش الگوریتمها؛

- اعمال تکنیکهای حذف سوگیری؛

- ایجاد استانداردهای جهانی برای شفافیت الگوریتمها؛

- تمرکز بر بهبود مهارتهای افرادی که الگوریتمهای خودکار را میسازند.

قدرت فزاینده شرکتهای بزرگ فناوری

ریسک ناشی از تمرکز منابع استراتژیک و فناوریها در دست تعداد محدودی از شرکتهای فناوری (Big Tech)، رتبه سیزدهم را در چشمانداز ۱۰ ساله دارد. این ریسک شامل سلطه بازار در بخشهای کلیدی مانند هوش مصنوعی و بیوتکنولوژی است. شرکتهای بزرگ در سیاستگذاری، اقتصاد و حتی امنیت ملی نفوذ فزایندهای دارند و میزان دسترسی و نظارت آنها بر دادههای شهروندان از دولتها هم بیشتر است.

از پیامدهای این ریسک میتوان به انحصار در فناوریهای مهمی مثل هوش مصنوعی و بیوتکنولوژی، محدودیت رقابت و نوآوری و تأثیرگذاری بر سیاستهای ملی و جهانی اشاره کرد.

اقدامات پیشنهادی

- تقویت قوانین ضدانحصار دیجیتال؛

- تشویق مدلهای کسبوکار مسئولانه؛

- همکاری بینالمللی برای تنظیم فعالیتهای فرامرزی.

نتیجهگیری

ریسکهای دیجیتال و اجتماعی برجستهشده در گزارش ریسکهای جهانی ۲۰۲۵، از جنگ سایبری گرفته تا تمرکز قدرت در دستهای شرکتهای بزرگ فناوری، جهان را در آستانه نوعی بیثباتی عمیق قرار دادهاند. با پیشبینی ۶۲درصد از کارشناسان برای چشمانداز دهسال آینده، نیاز فوری به همکاری همهجانبه، آموزش گسترده سواد دیجیتال و تقویت حکمرانی اخلاقی برای جلوگیری از تهدیدهای سایبری وجود دارد.